Durante el evento Google I/O 2025, la empresa anunció SignGemma, un nuevo modelo de inteligencia artificial creado especialmente para traducir lenguaje de señas a texto hablado, en tiempo real.

Desarrollado por el equipo de Google DeepMind, SignGemma promete transformar la comunicación de personas con discapacidad auditiva o del habla, permitiendo que se comuniquen con mayor facilidad con quienes no entienden el lenguaje de señas.

La gran novedad es que SignGemma será de código abierto (open-source), lo que significa que cualquier persona, empresa o desarrollador podrá usarlo, adaptarlo o integrarlo en otras soluciones.

Según Google, la tecnología abre puertas a una serie de aplicaciones accesibles en diversos contextos, como escuelas, servicios públicos, atenciones médicas, entre otros.

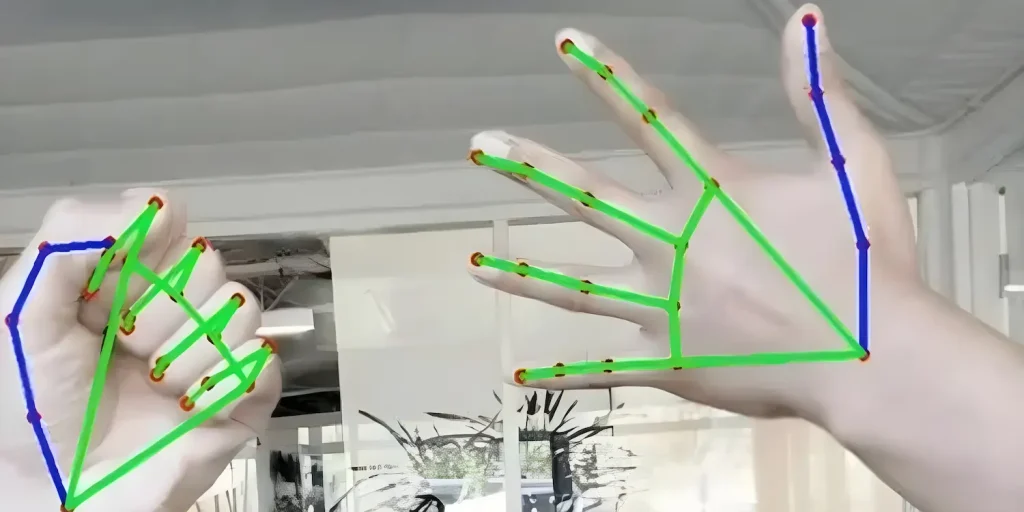

El modelo es capaz de identificar e interpretar movimientos de las manos, formas y expresiones faciales, convirtiendo estas señales en texto hablado con fluidez.

Fue entrenado con diferentes estilos de lenguaje de señas, y su mejor rendimiento en este momento es con el ASL (American Sign Language).

Además, el sistema funciona localmente, es decir, no necesita conexión a internet para operar, lo cual es ideal para lugares con conectividad limitada.

Basado en la estructura de Gemini Nano, SignGemma podría integrarse en el futuro con otras herramientas de la empresa, como Gemini Live.

Google también creó un formulario para que los interesados puedan probar la novedad antes de su lanzamiento oficial, previsto para finales de este año.