Google anunció la llegada de un nuevo miembro de la familia Gemini 2.5. Se trata de Gemini 2.5 Flash-Lite, un modelo de inteligencia artificial desarrollado especialmente para quienes necesitan rapidez en tareas a gran escala, como la traducción de textos y la clasificación de datos.

La novedad ya está disponible en versión preview, mientras que los modelos más potentes, Gemini 2.5 Pro y 2.5 Flash, ya están oficialmente liberados para su uso en producción.

Según Google, Flash-Lite presenta un rendimiento superior a los modelos de la generación 2.0 en pruebas de codificación, matemáticas y razonamiento.

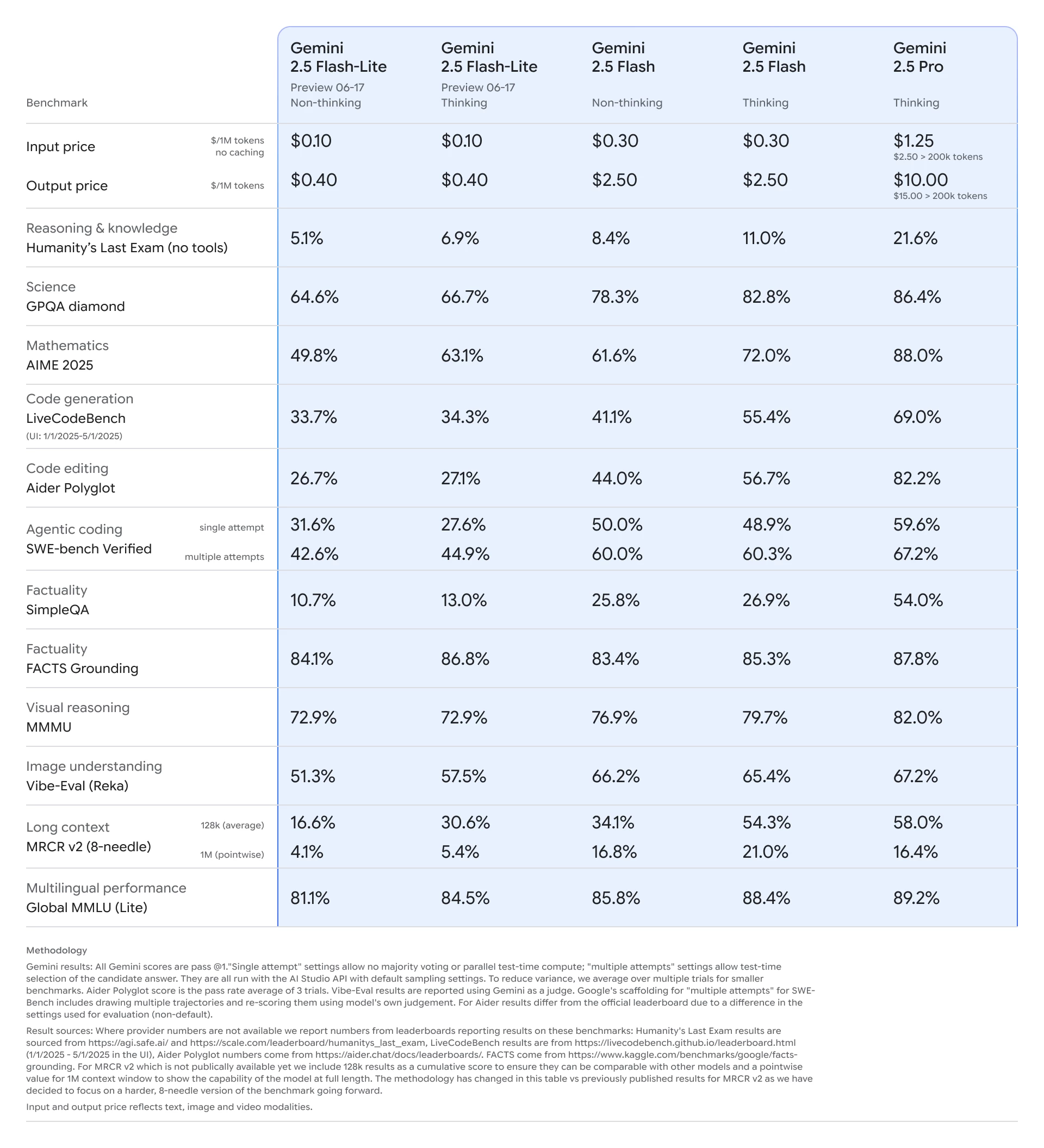

Sin embargo, su propuesta no es resolver tareas extremadamente complejas, sino entregar velocidad y economía. Esto se refleja en el precio: US$ 0,10 por millón de tokens de entrada y US$ 0,40 por millón de tokens de salida, lo que lo convierte en la opción más accesible entre los modelos de la empresa.

Una de las grandes novedades de Flash-Lite es la función llamada modo «Thinking». Cuando se activa, el modelo tarda un poco más en procesar la tarea, pero entrega respuestas mucho más precisas.

Por ejemplo, en una prueba avanzada de matemáticas, el rendimiento del modelo salta de 49,8% a 63,1%, mostrando una ganancia significativa en la capacidad de resolver problemas más complejos. Este mismo efecto aparece en tareas de búsqueda e interpretación de grandes volúmenes de información.

El nuevo modelo ya está disponible para pruebas en Google AI Studio y en la plataforma Vertex AI, dirigida a desarrolladores. Los modelos más poderosos, Gemini 2.5 Flash y 2.5 Pro, también pueden ser accesados en estos entornos y están integrados en la aplicación principal de Gemini, dirigida a los consumidores.

Según Google, versiones personalizadas de estos modelos ya están siendo utilizadas internamente, incluso en el motor de búsqueda de la empresa.